Un modelo híbrido de la cóclea revoluciona el reconocimiento automático del habla

Un modelo híbrido de la cóclea revoluciona el reconocimiento automático del habla

Redacción

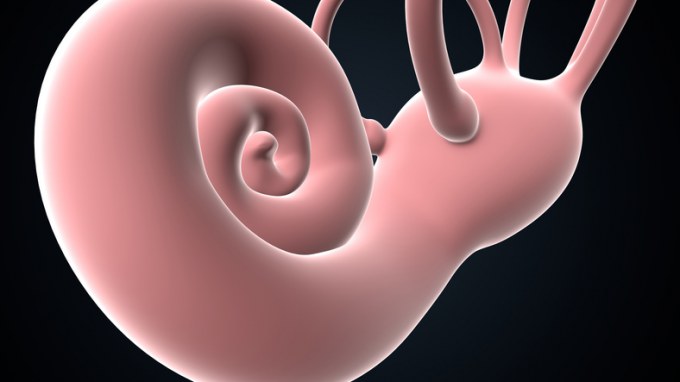

En un avance notable para la investigación auditiva y el procesamiento automático del habla, un equipo de investigadores del Instituto de Investigación Idiap y el Instituto Federal Suizo de Tecnología en Lausana (EPFL) ha desarrollado un sistema híbrido que integra un modelo de la cóclea basado en filtros con un modelo acústico preentrenado de gran escala. Este trabajo, liderado por Louise Coppieters y Philip N. Garner, ha sido publicado en la revista ‘Acoustics’ y propone una innovación que promete mejorar tanto la precisión como la interpretabilidad —relación entre teorías formales que expresa la posibilidad de interpretar o traducir una en la otra— de los sistemas de reconocimiento automático del habla.

Modelo híbrido

El reconocimiento automático del habla se ha caracterizado por el uso de modelos preentrenados que funcionan como cajas negras, donde la comprensión detallada de los procesos fisiológicos queda relegada. En contraposición, el trabajo de Coppieters y Garner adopta un enfoque integrador, incorporando un modelo de la cóclea que simula de manera plausible los mecanismos fisiológicos del oído humano.

La investigación demuestra que este sistema híbrido puede ser entrenado y evaluado mediante diversas combinaciones de afinamiento fino y autosupervisión. "Los resultados muestran que el sistema genera automáticamente estructuras que son conocidas por su efectividad, sin los artefactos presentes en nuestros trabajos previos con modelos neuronales menos sofisticados", explican los autores.

Evitar la ‘catástrofe del olvido’

El estudio detalla varios experimentos para explorar el comportamiento de los filtros a entrenar dentro de este marco. Uno de los puntos clave es la capacidad de entrenar un nuevo codificador sin perder la información adquirida durante el preentrenamiento del transformador. Esto se logra evitando la ‘catástrofe del olvido’ de los pesos del transformador.

Un hallazgo interesante es que, al sustituir el codificador CNN por uno SincNet, se destaca la importancia de la información de frecuencia en la capa de filtros a entrenar. Además, los experimentos revelan que el codificador SincNet converge más rápidamente que el CNN, aunque no muestra una mejora significativa en el rendimiento general ni en la interpretabilidad a lo largo del espectro de frecuencias.

Mejora para la investigación auditiva

La integración de filtros entrenables y la autosupervisión en un sistema híbrido no solo es factible, sino que también ofrece una flexibilidad superior para la realización de experimentos. Aunque el camino de preentrenamiento y afinamiento se alinea mejor con el concepto de autosupervisión, requiere un conjunto de datos más grande y un tiempo sustancialmente mayor.

La investigación concluye que esta estructura híbrida permite aprovechar los grandes modelos y bases de datos de los que de otro modo no se beneficiaría la investigación auditiva. "Implementar modelos fisiológicos más intrincados y emplear este enfoque puede facilitar una comprensión más profunda de cómo los mecanismos fisiológicos pueden evolucionar para interpretar mejor los inputs externos en la red de codificación", señalan Coppieters y Garner.

Este trabajo no solo abre nuevas vías para la investigación en reconocimiento del habla, sino que también promete avances significativos en la comprensión de los procesos fisiológicos auditivos. Este entendimiento allana el camino hacia tecnologías más precisas y eficientes en el procesamiento del habla.