Ya no es ciencia ficción. Es la ficción de la ciencia

Ya no es ciencia ficción. Es la ficción de la ciencia

Como artista invitada contamos nada menos que con Cate Blanchet, la australiana y laureada actriz (El Aviador, Blue Jasmine…). Y el papel principal lo ostenta Nadia, que está haciendo sus pinitos en esto del Deep Learning. Enfrente, en el patio de butacas, ocupan las primeras filas, entre otros sesudos intelectuales e investigadores, representantes de Google, Amazon, Apple, Facebook, Microsoft, IBM y Tesla. Están también Steve Wozniak (cofundador de Apple), Stephen Hawking y personajes quizá menos conocidos como Nick Bostrom, director del Future of Humanity Institute de Oxford, o Stuart Russell de la Universidad de Berkeley. Un auditorio sin duda de altura, quizá algo dividido entre la condescendencia y la exigencia.

De momento la obra parece haber superado la fase de planteamiento y nos introduce en un nudo de desenlace incierto aunque apasionante.

Lo cierto es que este tinglado, a pesar de las apariencias del enfoque que me permito, no tiene nada de Show y sí mucho de Business, aunque me fijaré más en el hecho de que contemplar los avances que se van realizando en tecnología digital y robótica no deja de parecerse a un espectáculo. ¿Su título? Podría ser algo como “¿Inteligencia artificial…? No, lo siguiente: Inteligencia emocional”. O si prefieren la versión más críptica: “de la AI a la EI”.

Las máquinas nos entienden… y se emocionan.

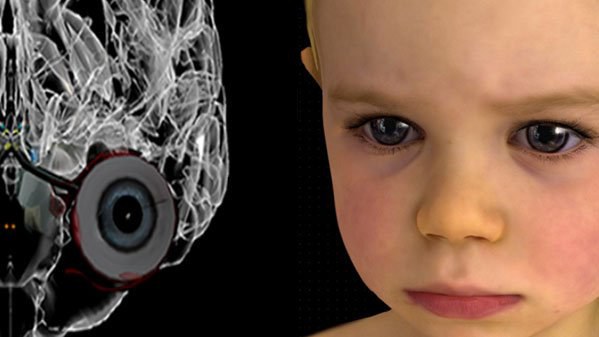

Soul Machines es la empresa que ha desarrollado este nuevo y particular chatboot (un robot capaz de interactuar con nosotros a partir de nuestros mensajes verbales). Nadia, que así se llama, posee para empezar el encanto y atractivo de una voz de lujo, la de Cate Blanchet, lo cual ya es motivo suficiente como para colocarla en lugar destacado entre nuestros androides preferidos. Pero lo importante es que, a diferencia de sus hermanos de código, Nadia da un paso más allá de la inteligencia meramente artificial para, según sus creadores, incorporar la Inteligencia Emocional. En otras palabras es un humanoide más “humano” en tanto que es capaz de leer e interpretar también nuestras expresiones faciales y respondernos de igual forma. Se consigue así un intercambio de mensajes más complejos que, en palabras de su CEO Mark Sagar, posibilita una mejor comprensión mutua y una más fluida “conversación”.

Hay que decir que el rostro de Nadia está confeccionado al detalle. Ante el brillo de sus ojos cuesta recordar que lo que esconden son circuitos y tornillos. El caso es que Nadia trabaja con la llamada Inteligencia Emocional, calificativo posiblemente excesivo puesto que lo que hace es “traducir” también las expresiones no verbales para adecuar mejor la respuesta. Un encomiable uso de este chatboot, sobre el que se están haciendo ya ensayos, es la ayuda que puede suponer para personas con ciertas discapacidades.

Cerebros de artesanía

Estamos ante el uso de redes neuronales artificiales de inspiración biológica que emulan el funcionamiento del cerebro, aproximando estos neurotransmisores y hormonas virtuales a “nuestra” dopamina, serotonina u oxitocina. El conjunto pretende representar un escenario parecido al que, sea como causa o como efecto, provocan en el ser humano sus comportamientos y emociones.

Conviene recordar que una red neuronal artificial se compone de diferentes capas de cálculo, al igual que cada parte del cerebro asume diversas tareas. El punto de partida en ambos casos es la información recibida, así como la capacidad de procesamiento e interpretación de dichos inputs que, también en el caso del software que sostiene la inteligencia artificial o/y emocional, se apoya en parte en el aprendizaje (deep learning). El algoritmo, del cual es buena muestra el modelo de AI de Google, Deep Mind, se basa en el concepto neurológico de la Consolidación Sináptica que aquí se transforma en el EWC (Elastic Weight Consolidation) o Consolidación de Peso Elástico. Se trata, en palabras simples, de aplicar a la inteligencia artificial la capacidad que nuestro cerebro tiene de aprender de forma incremental.

Hasta aquí el libreto de la obra. Intrigante, apasionante y de final abierto. Este espectáculo al que asistimos atónitos los no expertos, me refiero a la aparición de robots como Nadia, asistentes digitales como Alexa, desarrollos de IA como Deep Mind y otros, generan una mezcla de asombro, esperanza e inquietud. Las no tan lejanas películas de ciencia ficción están tomando cuerpo y su –según nos parecía– desbordante fantasía resulta que está ya presente en cualquier teléfono móvil.

La incertidumbre forma parte del desarrollo de la humanidad. Desde el fuego a la descomposición del átomo, los avances que nos han hecho crecer siempre han nacido impregnados de dudas. La historia nos demuestra, además, que su bondad o maldad no forma parte intrínseca del descubrimiento sino de la mente humana que decide su uso. Y en eso estamos también en estos tiempos en los que precisamente aquello que nos distingue del resto de la creación, la inteligencia, resulta que puede “fabricarse”…. O casi.

De ahí que en nuestra “platea” más de uno se mueve inquieto en su butaca como si no terminara de ver claro a dónde conduce esta particular representación. … Y es que se echa en falta la voz de la crítica, que aún está recogiendo datos para emitir su juicio. Hablo de la ética como referencia y el sentido común como exigencia, invitados ambos en primera fila.

Declaración de intenciones.

Los que al principio bautizaba como espectadores forman parte de la Partnership for AI, una gran alianza que, mediante el respeto a unos principios que sus miembros asumen, busca guiar los avances en Inteligencia Artificial hacia “la calidad de vida de las personas ayudando a resolver problemas como el cambio climático, la alimentación, la salud y la educación”. En otras palabras, trata de definir un objetivo y, con ello, delimitar unas fronteras al desarrollo de la AI. Y sí, ahí están los gigantes de la tecnología digital ya citados y también un nutrido grupo de científicos, investigadores y expertos de diversos campos directamente implicados con la Inteligencia Artificial o colaterales a ella que, aunque el grupo solo se ha reunido una vez, el pasado 3 de Febrero, aprovechan otros medios para expresar sus inquietudes: “la inteligencia artificial puede reflejar los prejuicios de la sociedad y de sus propios creadores”; “su capacidad de aprendizaje puede llevar a conclusiones inesperadas y quizá graves”; “uno de los retos principales es definir los sistemas de control humano respecto las máquinas que incorporen AI”; “confiar cada vez más decisiones que afectan a distintas facetas de nuestras vidas a un algoritmo requiere vigilancia y ciertos criterios”.

La Partnership for AI, en suma, no quiere ser considerada como un lobby, entre otras cosas porque no propugna una legislación que incida en los avances en Inteligencia Artificial, sino más bien la definición de una base ética de cumplimiento voluntario por parte de los actores implicados.

Estamos, me da la impresión, fabricando muy rápido un vehículo que aún no sabemos dónde puede llevarnos y, lo que llama más la atención, del que no tenemos normas de conducción. Existe una enorme autopista pero no se han inventado todavía las señales de tráfico para que la inteligencia artificial, y emocional y… lo que venga, además de correr, lo haga minimizando riesgos y sin perder de vista el objetivo.

La metáfora teatral con la que he intentado en estas líneas vestir tal panorama tiene su intencionalidad.

Show must go on…?

Creo que a diferencia de otros grandes avances que a lo largo del tiempo han terminado por afectar a nuestra vida diaria, como el alcantarillado, la máquina de vapor o la electricidad por ejemplo, la tecnología digital tiene quizá un componente de espectáculo que nos lleva a contemplarla desde un plano lúdico y a veces demasiado superficial. Las redes sociales nos entretienen; Siri es ya uno más en casa, como Amazon; el robot aspiradora nos tiene absortos viéndole sortear obstáculos; y esto de que un robot como Nadia parezca tan humano y, además de entender lo que le decimos, ahora, además, “sienta” casi como nosotros no me dirán que no merece un aplauso entre signos de admiración.

Nos seduce jugar con ello e incluso con su trasfondo más serio. Buen ejemplo es que el mismo MIT (Massachusetts Institute of Tecnology) nos propone pasar un rato entretenido decidiendo qué comportamientos moralmente adecuados debería tener un coche autónomo cuando, por ejemplo, ha de optar entre atropellar a una viejecita o estrellarse contra una farola.

Quizá estamos demasiado distraídos ante tanta magia digital, entretenidos con cada vez más numerosos y sofisticados artilugios plug&play y no trascendemos dicha superficie para llegar al fondo. El análisis de la trascendencia de esta realidad digital y con inteligencia propia nos debería llevar a enfrentarnos a las consecuencias de su creación y difusión que, como siempre, dependerán de la gestión que hagamos de ella. Como saben quienes en una empresa administran recursos materiales y humanos, tal responsabilidad exige tener unos criterios claros, llamémosle una “filosofía ” definida. Sin embargo, en el ámbito que tratamos echo en falta tales fundamentos. La alianza Partnership for AI los promueve, pero me temo que no pasará de ahí. La responsabilidad está en manos de los actores, llámense Zuckeberg, Bezos, Musk… y de los científicos. Y también en nuestras manos que, a fin de cuentas, alimentamos su existencia.

La obra promete y ojalá se mantenga mucho tiempo en cartel con éxito de crítica y público, pero necesitamos ser tan inteligentes para interpretarla como para entenderla y disfrutarla.